連日の酷暑日に加え、お盆を迷走台風が直撃し、新幹線も計画運休だけでなく停止するという悪条件でしたが、いかがお過ごしでしょうか?

さてChatGPTのサービス開始を皮切りに、ニュース等で目にする機会が増えた生成AIですが、読者の中には生成AIを使いこなしておられる方、会社で導入されているから使っているという方もおられるのではないかと推測します。今月は生成AIの幻覚(hallucination)と偽物(fake)を取り上げます。

幻覚(hallucination)

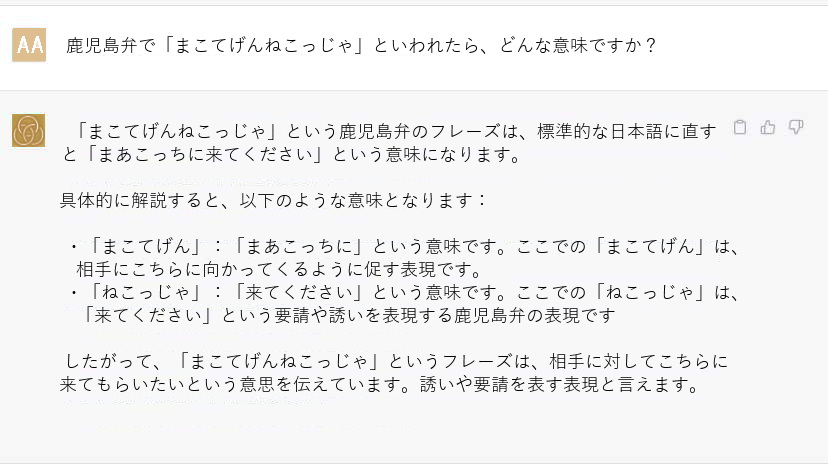

「まことに恥ずかしいことです」を意味するはずが、「まぁこっちに来てください」と間違えた意味となり、解説までついています。

ちなみに筆者がChatGPTに同じ質問をしてみたら「「まこてげんねこっじゃ」は、鹿児島方言で使われる表現です。正式な日本語に訳すと「まことに困ったことだ」という意味です。この表現は、何か困難な状況や問題に直面したときに使われることが多いです。鹿児島の方言は他の地域の方言と異なる表現や言い回しが多く、地域によって独自の言葉やフレーズが存在します。」とのことでした。

実は本コラムでhallucinationを取り上げようと日本語の意味を調べて、初めて「幻覚」であることを知りました。それまでは生成AI特有の用語ぐらいにしか思っていませんでした。

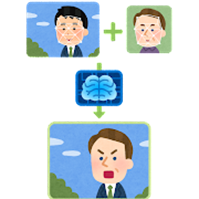

Wikipediaで調べると「幻覚(げんかく、英語: hallucination)とは、外部からの刺激がないときに、現実の知覚と同じような性質を知覚することである。」となっていて、いつものいらすとやで「幻覚」を検索すると図2のようなイラストがヒットします。

一方でWikipedia には幻覚(人工知能)の項目もあり、「人工知能の幻覚(hallucination: ハルシネーション)とは、人工知能が学習したデータからは正当化できないはずの回答を堂々とする現象である」となっています。「回答を堂々とする」という擬人化された表現に思わず吹き出してしまいます。まさに「堂々と回答する」の例が図1でしょう。大学教授などが専門用語を使って堂々と話すと、内容は理解できないけれど、正しいと思ってしまうのと似ているかもしれません。

英語のWikipediaでは「作話(confabulation)や妄想(delusion) などの表現も使われる)と書かれています。幻覚は外部刺激がないという定義があるので、個人的には、生成AIでは、AIプロンプトから質問や指示などを入力するし、外部刺激を得ているので、幻覚よりは作話というのが近いように感じます。

現在放送中のTBS日曜ドラマ「Vivant」で主人公が自分の分身と対話している場面が出てきますが、これも「幻覚」でしょう。いずれにしても、今は「幻覚」ばやりということなのかもしれません。

偽物(fake)

生成AIに限らず、AIではhallucination登場の前から偽物(fake)が問題になってきました。フェイクファー(人造毛皮)など堂々と使われているフェイクですが、いらすとやには、それらのフェイクと並んで「ディープフェイク」のイラストもあり、AIが作り出すフェイクが一般的になってきていることの証左でしょう。ディープフェイクで有名なのはオバマ元大統領がトランプ前大統領をののしる動画(https://www.youtube.com/watch?v=cQ54GDm1eL0)です。途中から全くの別人に語らせているのに唇の動きが完全にシンクロしているのが印象的です。

フェイクを検知する技術も開発され、それをもとにしたスタートアップにはベンチャーキャピタルがたくさん投資をしています。例えば盗作をチェックする「Copyleaks」は2022年、775万ドルの資金を調達しました。米国防総省の「国防高等研究計画局(DARPA)」は2023年に、ディープフェイクを自動的に検出し、悪意があるかどうかを判断するアルゴリズムを開発するプログラム「Semantic Forensics」に約3千万ドルを投資します。

また、群馬で開催されたG7群馬高崎デジタル・技術大臣会合「<2023年4月>では一定の規制の下で活用し「信頼できるAI」の実現を目指すことなどを盛り込んだ共同声明が採択されました。作成者がAIであることを明確に示すことなどの具体策が世界的に検討されています。

信頼できるAIを実現するにはhallucinationを生み出さないようにするだけでなく、著作権を侵害しない情報を基にした学習など様々な課題があります。

生成AIの幻想や偽物に騙されないようにするには、使い手である人間自身が目利きになる必要があります。生成AIに問うだけでなく、自身でネット検索するなど、複数の情報源を持ちダブルチェックする必要があります。つまり自身が「意思決定をするのに十分な知識を得ている」と自信が持てるようにすることが、情報の罠に嵌まらない秘訣と言えます。

昨年5月に開始した「日常に潜む情報通信技術の罠」シリーズは、今回をもち終了します。9月からは「ICT(情報通信技術)おばあちゃんの四方山話」と題して、情報通信技術だけでなく、それを支える企業や人々まで対象を広げた新たなシリーズを展開予定です。乞うご期待です。

(2023年8月)

筆者紹介

土井 美和子氏

国立研究開発法人情報通信研究機構 監事(非常勤)

東北大学 理事(非常勤)

奈良先端科学技術大学院大学 理事(非常勤)

株式会社三越伊勢丹ホールディングス 取締役(社外)

株式会社SUBARU 取締役(社外)

日本特殊陶業株式会社 取締役(社外)

1979年東京大学工学系修士修了。同年東京芝浦電気株式会社(現㈱東芝)総合研究所(現研究開発センター)入社。博士(工学)(東京大学)。以来、東芝にて35年以上にわたり、「ヒューマンインタフェース」を専門分野とし、日本語ワープロ、機械翻訳、電子出版、CG、VR、ジェスチャインタフェース、道案内サービス、ウェアラブルコンピュータ、ネットワークロボットの研究開発に従事。